O que estamos desenvolvendo?

São necessários cinco grandes desenvolvimentos em duas frentes para os veículos autônomos:

Percepção: os veículos conseguem perceber o que está ao seu redor;

Predição: os veículos conseguem prever como o que está ao seu redor (percepção) irá se alterar;

Modo de condução: os veículos conseguem seguir um conjunto pré-estabelecido de regras para se locomover de maneira segura.

O modo de condução é provavelmente o módulo mais comentado, mas na prática não é o maior problema que encontramos. Sebastian Thrun, fundador do projeto do Google para carros autônomos, estima que este problema representa apenas 10% do desafio.

Percepção

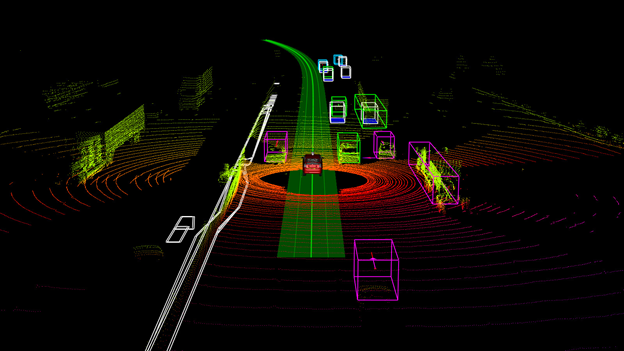

Nos projetos atuais, os veículos entendem o que está ao seu redor através de câmeras e radares, por exemplo, o LIDAR (um sensor que utiliza pulsos invisíveis de luz para criar um mapa 3D da região). As câmeras são baratas e, com a evolução dos algoritmos de IA, é possível compreender as sinalizações de tráfego, mas os algoritmos ainda têm dificuldade para medir distância e/ou velocidade. O LIDAR, por sua vez, consegue ter alta precisão, mas ainda é extremamente caro e tem dificuldades de lidar com alguns fatores, como por exemplo a neve ou a chuva. A estrutura para o LIDAR atualmente custa dezenas de milhares de dólares, o que torna veículos com a tecnologia bastante caros. O LIDAR cria imagens como a abaixo:

Hoje, a maior parte das empresas que trabalham nos self-driving vehicles operam com um misto das três tecnologias – exceto a Tesla que acredita que a melhor solução envolve apenas o LIDAR. Há diversas startups trabalhando atualmente na redução do preço do LIDAR, o que pode beneficiar muito a estratégia da Tesla.

Após receber as imagens, softwares embarcados utilizam técnicas de visão computacional para reconhecer o que aquelas imagens realmente querem dizer, matemática semelhante às que aCobli está testando para ler fotos de bombas de combustível. Em ambos os casos, para o reconhecimento funcionar bem, é necessário um grande volume de dados catalogados para treinar os algoritmos de inteligência artificial por trás do sistema. Startups como a Mighty AI já contam com bancos de dados superior à 300.000 imagens. Como curiosidade, utilizam inclusive imagens de jogos e simuladores de alta fidelidade, como Grand Theft Auto (GTA), para treinar esses modelos.

Conforme mais e mais veículos dotados de sensores de alta precisão passam pelas mesmas situações e compartilham suas “experiências” o aprendizado vai ficando mais fácil e os resultados melhores. Isso é atualmente nomeado como aprendizado de frotas ou fleet learning.

Predição

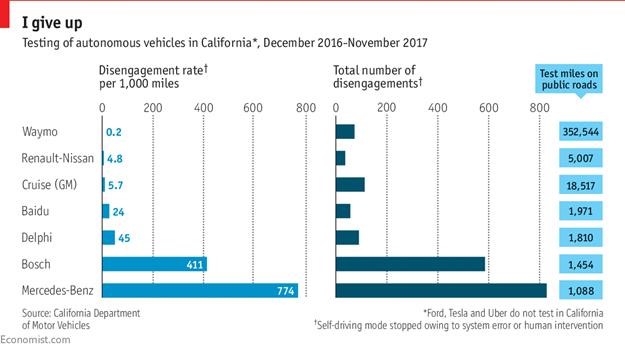

Focando nos cenários sem neve, em que o LIDAR funciona melhor, ainda encontramos muitos problemas para o funcionamento 100% autônomo. Atualmente, sempre que o software encontra um problema em que não tem confiança na resposta, acontece o chamado “desengajamento”, onde a máquina passa a condução para um engenheiro de segurança. O gráfico abaixo mostra um resumo atual de como os principais players estão performando:

Por mais que o desengajamento seja, em uma certa medida, um fracasso, é através dele que os sistemas aprendem novas situações e ficam cada vez mais robustos.

Possivelmente, mesmo após os veículos autônomos estarem em uso pelo grande público, ainda haverá necessidade de alguns desengajamentos e auxílio de motoristas humanos.

Os graus da evolução

Como a maior parte do desenvolvimento de softwares modernos, os veículos autônomos operam em fases e lançamentos incrementais. Em geral, são divididos em 5 fases:

Nível 1: assistência básica ao condutor, “piloto automático” ou alertas de direção agressiva são exemplos que já vemos no dia- a-dia. Apenas os dados do veículo em si são analisados neste nível;

Nível 2: o veículo já tem habilidade para começar a reagir ao ambiente. Manter-se dentro da faixa é um dos melhores exemplos. Neste nível, é necessária total atenção de um motorista qualificado a todo momento;

Nível 3: conhecido como “Assistência condicional”, é um nível em que em algumas situações o veículo já é capaz de se dirigir sozinho. A atenção do motorista ainda é crítica, mas em condições mais controladas o veículo possui grande autonomia;

Nível 4: alta autonomia em cenários específicos. Neste nível os veículos serão capazes de operar normalmente em regiões e situações específicas de curvas, acelerações ou frenagens. Daqui em diante o motorista não precisará mais ficar em estado de total atenção. Google e Uber pretendem ir diretamente para este nível, pois acreditam que níveis com muita necessidade de supervisão são mais perigosos. Exemplo disso é o motorista do Tesla Model S, nível 2, que morreu após não conseguir reagir a tempo aos alertas de seu veículo e tomar controle;

Nível 5: autonomia total. Este é o objetivo final. Aqui não é necessário um volante ou pedais. O veículo faz tudo sozinho sempre.

Expectativas do futuro

Os veículos autônomos terão um custo mais barato do que os atuais, o que claramente é uma das grandes forças que impulsionam o seu desenvolvimento. A segurança em longo prazo provavelmente será muito maior também. A Waymo, por exemplo, já dirigiu mais de 6 milhões de quilômetros e os únicos acidentes que ocorreram foram por culpa de motoristas em outros veículos.

No gráfico abaixo, há uma estimativa do banco UBS sobre os custos:

Na prática, o custo por km é inferior a metade de um carro privado hoje em dia. Isso pode incentivar cidades a construírem regiões específicas feitas para viabilizar veículos autônomos. Como “trilhos” que facilitariam e aumentariam muito o uso de veículos com níveis de autonomias menores.

Consultorias como a BCG estimam que, em 2035, cerca de 80% dos veículos já serão autônomos. Com isso, é esperado que apenas nos EUA haveria uma economia de 30 bilhões de horas por ano.

Considerando a situação como um todo, tivemos muitos avanços na tecnologia. No entanto, ainda há um longo caminho para que os veículos funcionem sozinhos. No mais, qual será o impacto na legislação e na sociedade?

*por Rodrigo Mourad é sócio da Cobli, startup especializada em controle de frotas, telemetria e roteirização